Tokina AT-X PRO DX 12-28 mm f/4 - test obiektywu

Komentarz można dodać po zalogowaniu.

Zaloguj się. Jeżeli nie posiadasz jeszcze konta zarejestruj się.

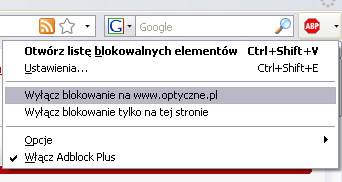

Optyczne.pl jest serwisem utrzymującym się dzięki wyświetlaniu reklam. Przychody z reklam pozwalają nam na pokrycie kosztów związanych z utrzymaniem serwerów, opłaceniem osób pracujących w redakcji, a także na zakup sprzętu komputerowego i wyposażenie studio, w którym prowadzimy testy.

Optyczne.pl jest serwisem utrzymującym się dzięki wyświetlaniu reklam. Przychody z reklam pozwalają nam na pokrycie kosztów związanych z utrzymaniem serwerów, opłaceniem osób pracujących w redakcji, a także na zakup sprzętu komputerowego i wyposażenie studio, w którym prowadzimy testy.

Będziemy wdzięczni, jeśli dodasz stronę Optyczne.pl do wyjątków w filtrze blokującym reklamy.

Z góry dziękujemy za zrozumienie.

Kliknij tutaj aby zamknąć to okno.

Komunikat nie wyświetli się więcej podczas tej sesji (wymagana obsługa cookies).

Używam od kilku lat wersji 12-24 korygując aberrację chromatyczną w wywoływarce RAW. Efekty zdjęciowe są świetne. Mój syn ma wersję 11-16 i też po programowej korekcji A CH ma świetne rezultaty.

Dodam, że nie mam nic wspólnego z producentem ani dystrybutorem tej firmy

Jak by nie było CA, efekty zdjęciowe byłyby bardziej niż świetne.

Miałem okazję podpiąć ten obiektyw, na szybko co się rzuca w oczy to małe zniekształcenia. Napalałem się na niego jak szczerbaty na suchary ale musi poczekać. Trochę przeszkadza mi ta abberacja (tak, wiem, soft naprawi) i nie trochę praca pod słońce. Szeroki kąt przydaje się do landszaftów, tam to przeszkadza, i na imprezy. Tam też to może dokuczać. I tu rodzi się pytanie, co będzie lepsze, T12-28 czy N12-24??

Znowu Tokina i znowu potężna aberracja... Tam u nich sami daltoniści pracują, czy jak?

Arek:Tokina 2:0

Wciaz te same problemy. I jak tu glosic, ze technologia ED bardzo potaniala?

@Saberwulf: Sigma 10-20...? :D albo N 10-24. 12-24 nie ma co sobie głowy zawracać...

No oni szkło ED dają. Nawet dwa rodzaje. Tylko najwyraźniej nie potrafią go właściwie wykorzystać.

Arek, zajmujemy się fotografią?, czy technologią?. Kurczę, pracujemy w epoce komputerów. Cieszmy się nowymi technikami i wygodą z nimi związaną. Moją przygodę z fotografią zaczynałem martwieniem się czy dostanę chydrochinon albo inny składnik. Bardzo mnie cieszy, ze oprogramowanie a nie wysoka cena skoryguje aberację chromatyczną. Jestem praktykiem - interesuje mnie końcowy efekt za rozsądną cenę.

Może być osiągniety dowolną technologią - to nie ma znaczenia

Rozumię, że dla astronomów aberracja chromatyczna to sprawa krytyczna pracujecie oczami. Fotografowie patrzą inaczej - zazwyczaj drukują. A tu to nie jest jakaś kłopotliwa wada - usuwamy programowo

"hydrochinon" - czyba?

Piter - astronomia nie ma tutaj nic do rzeczy. CA psuje rozdzielczość. Tego programem i nowymi technikami nie naprawisz.

Zgadzam się, że CA psuje rozdzielczość. Ale nie aż tak jak cena. Programowa korekcja CA pozwala na osiągnięcie kompromisu ceny do wyników optycznych. Myślę, że dobrze by było uwzględnić w testach taki kompromis. Arku szanuję Twoją wiedzę i kompetencję. Ale jako praktyk nie zgadzam się do końca z końcowymi wynikami testów. Wprowadź w testach kategorię "programowa korekcja CA" Przeciętnym użytkownikom szkieł da to praktyczne wrażenie końcowych wyników. Ortodoksom sprzętowym udostępniaj "gołe" testy. Jesteś profesjonalistą myślę, że rozumiesz o co mi chodzi? Rozdziel testy. Częściowo już to robisz przez podział na jakość .jpg i .raw.

sorry za składnię

@Piter: tylko pytanie co taki pomiar miałby znaczyć? Można się uprzeć, że do "normalnej" obróbki obrazów wchodzi dekonwolucja. Otóż nie wyciągnie ona szczegółów gdy kontrast spada poniżej szumów w szczególności optycznych, obecnych w atmosferze. Ale może np wyciągnąć obraz którego na zdjęciu nie widzisz gołym okiem. Takie sztuki udają się np z tablicami rejestracyjnymi. Mogę sobie wyobrazić program z siecią neuronową który będzie dokonywał regeneracji zdjęć, bo będzie pamiętał kształt tablicy. Tylko, co to wszystko może mieć wspólnego z obiektywem? Myślę, że należy postąpić jak zawsze się w europejskiej nauce robi: podzielić problem na kawałki. Jeden funkcjonalny kawałek, to gołe właściwosci optyczne, drugi, to oprogramowanie. Moim zdaniem związek właściwości optycznych z działaniem oprogramowania jest bardzo luźny. Najwyżej jakiegoś obiektywu nie ma w bazie danych i przez czas do którego nie wrzuci się do niej jego właściwości, program będzie obsługiwał gorzej ten typ. Ale nie zmieni to np faktycznie uzyskiwanej rozdzielczości. Po drugie, jak nie podzielimy na kawałki pojawią się np jedynie słuszne programy do korekcji i będzie ogólny kociokwik. Zostawmy sprawy jak są: własności optyczne, oprogramowanie osobno. Bo się z rozumem nie połapiemy.

Moim zdaniem system m4/3 wygrywa jednak nad APSC. W tej cenie jest bardzo dobry olympus 9-18 f4-5,6 który wprawdzie ma gorsze światło ale optykę i wymiary o niebo lepsze. Do tego kontrastowy AF jest bezbłędny.

baron13 pisałem coś o "dekonwolucji?" i o "atmosferze?" Uważam, że taniej jest korygować CA programowo niż dużą kasą. Nawet za cenę "kociokwiku" jak to nazywasz - ale dobrymi treściowo fotkami.

W końcu najważniejsze są dobre fotki. Dobre fotki są celem. Sprzęt tylko kłopotliwym dodatkiem

baron 13 z tą siecią "neutronową" to już dałeś ciała - miałeś kiedyś w ręce aparat fotograficzny? z normalną kliszą? masz komputer i Photoshopa?

skanowałeś coś kiedyś?

dałeś coś z sukcesem do druku?

@Piter

link

Pani przed pomnikiem ks.Jerzego ma za luźny prawy sandał, to można skorygować.

No właśnie sieć neutronowa istnieje tylko w twoim poście Piter...

Możesz sobie korygować programowo ale w miejscu w którym aberracja występuje dane są utracone lub utracone częściowo.

A w takim wypadku mozna jedynie zgadywać bazując na sąsiednich pixelach, zgadnąć co przysłoniła aberracja albo ją usunąć. Co zawsze przyniesie obraz zubożony.

Polecam fotografom link przesłany przez "baron13" dużo się nauczycie

"ero" sieć neuronowa należy do "baron13"

@fanmario - takich rzeczy nie da się już skorygować ;)

Przykro mi, że tu nie da się rozmawiać merytorycznie. Trzymam kciuki Arku rób swoje to tobry portal. Nie zawsze się z Twoimi testami zgadzam. No ale to raczej rzecz gustu. Pozdrawiam piotr

Bardzo byłem ciekaw tego testu, bo jego odpowiednik ma podobno wyjść dla pentax'a. Mam tylko nadzieję, że pentax coś zrobi z tą aberracją, bo inaczej nie będzie sensu wymieniać mojego ulubionego 12-24.

Tak, zapewne pentax zrobi czary mary....

Dla mnie na przykład informacja o wadach optycznych jest kluczowa, ponieważ filmuję używając takich obiektywów. W filmie korekcja takich wad jest dużo trudniejsza i często nieopłacalna, w porównaniu do obróbki zdjęć. Dlatego liczy się tylko to, "co optyka dała".

I nie wiem, dlaczego wytykanie ewidentnych wad optycznych w obiektywie(!) ma być nie na miejscu. Tendencja naprawiania wszystkiego oprogramowaniem nie jest dobra, tym bardziej, że wcale nie jest tańsza.

Jako użytkownik tego obiektywu generalnie zgadzam się z wynikami testu. Jakość wykonania zrobiła na mnie wrażenie - wcześniej nie miałem styczności z nowymi konstrukcjami Tokiny. AF z Nikonem D3200 działa bardzo precyzyjnie i skutecznie jak na ten korpus, ale na krótkich ogniskowych zawsze jest łatwiej. Optycznie jest naprawdę nieźle. Od siebie dodam, ze w praktyce odblaski nie są tak dokuczliwe, ale czasem pojawia się spadek kontrastu. Aberracja nie jest taka straszna, jak by się mogło wydawać - bez pomocy softu mogłoby byc kiepsko.

Tydzień temu przetestowałem szkło na ślubie - sprawdziło się doskonale. Zakres jest niespotykany - uniwersalny, pozwala skupić sie na pracy, zamiast bawić się w zmianę obiektywów. Co dla mnie ważne - obiektyw idealnie komponuje się z 35/1.8, nie ma dziury w zakresie. Polecam :)

Szkiełko poza moimi zainteresowaniami - bo to DX - ale myślę że mogę napisać iż nie rozumiem jaki jest sens inwestowania w taki instrument który jest ledwie odpowiednikiem 18-42 do tego o kiepskim świetle i z dużymi niedomaganiami. Każdy amator który myśli o rozwoju już zapewne kombinuje czy korpus FF kupi teraz czy za 2 latka ( z wyjątkiem pentaxsiarzy ;l)

Do tego czasu spokojnie może poeksperymentować ze starymi manualami które na tych ogniskowych nie wymagają właściwie AF.

Od czerwca od szkieł APS-C oczekuję znacznie więcej - zwłaszcza od "kundelków" bo wielcy już raczej olali ten format.

focjusz, na rynku nie ma drugiego obiektywu o takim zakresie - dla mnie 28mm na dłuższym końcu ma duze znaczenie. UWA to jedyny zoom w mojej torbie. Dzieki temu, ze zakres dochodzi do 28mm nie musze uzupełniać zakresu kolejnym zoomem. Niestety szkła 11-16, 10-20, 10-24 tego wymagają, bo między 20 lub 24, a 35mm robi się spora dziura.

Miałem Sigmę 10-20. Sprzedałem, dołożyłem prawie 1000zł i kupiłem Tokinę. Za te pieniądze mogłem uzupełnić zakres, ale NIE CHCIAŁEM targać kolejnego ciemnego zooma, chciałem mieć jeden zoom UWA i stałki.

@focjusz: stare manuale 10-20: jest tego pełno.

ja też nie jestem zachwycony tym obiektywem, bo on nie dla mnie. w UWA zawsze wolę 1mm mniej na początku niż 3więcej na końcu. jak ktoś nigdy nie próbował 12mm na FF czy 14/2,8 to odpowiednik 18/5,6 wyda mu się wide enough.

to b dobre szkło do krajobrazów, a fajnie jest czasem pobawić się czymś szerszym i jaśniejszym.

powtórzę z testu 11-16MII: zamiast zoomów fajnie by było mieć jasną stałkę 10/1,8 pod apsc.

Nie rozumiem tej 'konieczności' uzupełniania zakresów przez ludzi... Od dawna łażę w góry z 12mm+55-210, pomiędzy 12 a 55mm okazało się że mi nic nie trzeba a mam lżej, zawsze to kwestia delikatnego dokadrowania. A tym bardziej nie rozumiem jak komuś może na końcu robić różnicę w zoomie ogniskowa 20/24 a 28mm... Jak bym miał stałkę 150/200mm która jest mniejsza albo lżejsza od 55-210mm to bym zamienił na nią zooma i nosił wycieczkowo tylko 12+np.150mm. I za DonYoorando - też bym chciał stałkę 10mm ale może być nawet światło 4-5.6 byle była dobra do widoczków i nieduża.

Co do zdjęć z tej Tokiny to jakoś aberracji nie zauważyłem, za to mam wrażenie że wszystko 'błyszczy':/

ikit - bo Nikony ją usuwają programowo.

Dodawanie do testów programowej korekcji CA to kompletny bezsens. Na tej zasadzie trzeba by dodać także wyostrzenie, redukcję winietowania itd. żeby pokazać jaki jest efekt końcowy. Test ma obiektywu ma sens tylko wtedy kiedy jest faktycznie testem tylko obiektywu, a nie 'co by można z tym zdjęciem zrobić gdyby mieć mega programy graficzne za 20000euro'.

Sorry, ale takiego mydła to już dawno nie widziałem. Nie mam pojęcia z czego to wynika. Z Aberracji Chromatycznej?

I nie wierzę, że mydło można skorygować programowo.

Jak oni to robią w tym Nikonie, że ich puszki potrafią od tylu już lat z marszu tak pięknie likwidować ACh dla nowych i nieznanych obiektywów nawet takich o "monstrualnej" aberracji? - Szacun! =)

ps Jak oni to robią?

@wzrokowiec: Zgadzam się z Tobą, też zwrócił moją uwagę mało kontrastowy obraz, jaki daje ta Tokina. Na nic wysoka rozdzielczość jak obrazek jest mydlany. Do tego kontrast jeszcze spada przy pracy pod światło...

@MaciekKwarciak

Gdzie Zuiko 9-18 ma lepszą optykę? Pod jakim względem? Bo chyba nie rozdzielczości?

Zuiko 45lppm, a ta Tokina 52lppm. Po uwzględnieniu wymiarów matrycy jest jeszcze większa różnica, bo Zuiko wychodzi jakieś 1200 lwph, a w Tokinie 1600 lwph.

Co do aberracji to używam Tokiny 12-24 i jakoś 90% zdjęć mam bez aberracji, mimo, że są to krajobrazy. Aberacje widać tylko na bardzo jasnym niebie - najczęściej na drzewach na tle bardzo jasnego nieba. Nigdzie indziej jej nie widzę. I to tylko pod odpowiednim kątem do słońca chyba, bo tylko na niektórych zdjęciach ją mam. Do tego ja przymykam przysłonę do f:5.6 lub f:8 to już w ogóle aberracje są niewielkie.

CA jest bardzo dokuczliwa. Jest też możliwa do usunięcia, gdy na zdjęciu nie ma widocznych nieostrości z zafarbami. O czym mógł by świadczyć test z usuwaniem CA? Pewnie o tym jak wiele czasu focista poświęcił czasu. Kiedy zrobiłem test:

link

Obiektyw 18-55 za 2 stówki ostatnio. To trochę inaczej:

link

No i dziś z kolejną wersją rawtherapee i kolejną wersją GIMP-a wychodzi jeszcze inaczej. Kiedyś wyostrzałem na obrazie rgb na krawędziach dziś na krawędziach na kanale "jasność". jak już wszystko zawodzi w walce z CA to zaznaczam z pomocą "wykryj krawędzie" sam kontu i zmniejszam nasycenie kolorów. Prawie zawsze w rawtherapee ręcznie da się wyciąć CA. Ale ja wracamy z imprezy z 16 GB zdjęć to ręcznie można sobie w łeb strzelić. Wniosek mój jest taki, że pewnie jakiś sens ma sprawdzenie jak te programowe sztuczki radzą sobie, ale włączanie tego do testu obiektywu narobiło by tylko zamieszania. Nie sądzę że koszt oprogramowania jest ważny ( chyba własnościowe i "open" działa bardzo podobnie) ale, powtórzę mielibyśmy tak naprawdę test samozaparcia operatora.

Co do mydlenia. Zdjęcie Tokiną 12-24 i Canonem 40D. Sharpness na 0.

link

Dla mnie brzytwa. Ale 40D ma matryce 10 megapikseli i to też swoje daję. Na matrycach 15-20 megapikseli nie da rady uzyskać brzytwy żadnym obiektywem przy sharpness na 0.

A. Zdjęcie z mojego linku na przysłonie f:5.6 i ogniskowej 18mm (czyli w środku zakresu Tokiny 12-24).

Przy okazji - aberacji żadnej też nie widzę na nim - ale ok, nie ma tu drzewa na tle nieba, tylko budynek na tle nieba.

Mam prawie setkę zdjęć z Sandomierza i aberracje widzę tylko na dwóch zdjęciach... I tylko na drzewie na bardzo jasnym niebie.

Nie wiem. Może to wpływ tego, że używam filtra polaryzacyjnego - może on usuwa aberrację... nie wiem.

@noworries - ja pisałem o amatorach. Jak się robi reportaż ślubny i ma body APS-C to szkło może się bardzo szybko zwrócić i w takich zastosowaniach jest zapewne do przyjęcia. Mi jednak chodziło o to że większość na swoich niepełnych klatkach nie zarabia raczej. Ci którzy mają kit to i tak raczej nie kupią tego jako drugie a tym którzy myślą o ( amatorskim ) rozwoju to też nie bo szczególnie wybitnych rezultatów tym szkłem nie osiągną.

@mgkiler - test Ziuko był na starum E-3 z 10 Mpix - nie wiem ile dokładnie to odpowiada na nowych matrycach ( np OMD) ale na pewno znacznie więcej.

@focjusz: Tokina 12-24 też była testowana na 10Megapikselach a ma 40lppm. Po za tym 40lppm na APSC to więcej niż 40lppm na micro 4/3, bo matryca większa (więcej milimetrów) czyli większa ogólna roździelczość. A Zuiko nie dochodzi do 40lppm. 35 max. Jest dużo słabszy nawet od pierwszej Tokiny 12-24.

byłoby naprawdę super gdyby redakcja chociaż spróbowała standaryzować wyniki pomiarów jakimś skryptem z możliwością zestawienia takich parametrów jak rozdzielczość. z pewnością ludzie jeszcze chętniej wracaliby na strony optycznych bo porównywanie to niesłychanie popularny sport w internecie. zresztą o takiej potrzebie piszą dosyć często w komentarzach sami użytkownicy, a i z ekonomicznego pktu widzenia wszystko przemawia za takim rozwiązaniem. czy jest szansa, że Redakcja zdecyduje się na taki ruch?

Niestety nie ma prostej metody standaryzowania.

jednak na jednym wykresie całkiem często prezentujecie centrum kadru, brzeg cropa oraz brzeg pełnej klatki, a porównania do konkurencji zamykacie w jednym akapicie - więc może jednak się da?

@up

Musiały by wszystkie obiektywy testowane być na tym samym aparacie. Czyli trzeba by wszystkie obiektywy testowane na Canonie 20D ponownie przetestować na 50D i ponownie wyliczyć wykres roździelczości.

ALBO.

Kupić tego Nikona, który ma 36 megapikseli i na nim testować :)

A dla APS-C Nikona D7100 - on ma 24 megapiksele na APS-C.

Żaden obiektyw nie jest wstanie takiej rozdzielczości uzyskać. W ten sposób wyeliminuje się wpływ body na obiektyw.

Dość dobrze wiadomo jak się rozdzielczość matrycy składa z rozdzielczością obiektywu. Rozmycie jest sumą geometryczną.

Powiedziałbym, że splotem :)

@mgkiler, matryca musiałaby być być dużo bardziej gęsta niż owe 24 Mpix D7100 żeby wyeliminować wpływ korpusu. Ręczę Ci, że na 30, 40, 50 Mpix APS-C MTFy będą coraz większe :). Zresztą nawet wówczas rezygnacja z interpolacji czy jeszcze coś innego przyniesie dalszy wzrost. W perspektywie najbliższych lat jedyny sposób to rozbicie pomiaru rozdzielczości układu na składowe (przynajmniej: matrycę i obiektyw), które potem można by dowolnie łączyć i porównywać (np. ww. Tokina z Zeissem na Canonie ;)). To jest do zrobienia, ale - jak pisze Arek - nie jest to proste. Wymaga wykonania przynajmniej jednego pomiaru na samym obiektywie lub samej matrycy, przyjęcia jakiegoś modelu matematycznego, analizy błędów - masa roboty bez gwarancji powodzenia. Typowy projekt badawczy, który wymaga czasu i dobrego finansowania

@Arek: przekonałeś mnie :-) Aliści trudniej się liczy...

TS - cieszę się, że to napisałeś. Dzięki za oszczędzanie mojego czasu :)

Tak naprawdę robiłem już kilka podejść do zorientowania się w sprzęcie, który będzie mierzył własności optyczne obiektywów niezależnie od matrycy. Takie cuda są dostępne na rynku. Tyle, że uniwersalna maszyna, która zmierzy obiektywy od rybiego oka począwszy do tele klasy 500 mm (a takie sprzęty chcemy testować) to koszt na poziomie grubych kilkudziesięciu tysięcy Euro.

Taniej wyjdzie zrobić samemu. Ale nie mam ani odpowiedniej wiedzy, ani doświadczenia, ani zaplecza warszatowo-sprzętowego.

@TS: A wiesz co to dyfrakcja?

Na mojej 10 megapikselowej matrycy widzę już dyfrakcje przy przysłonie np f:16.

Przy idealnym obiektywie i tak dyfrakcja ogranicza rozdzielczość optyczną.

Tu jest kalkulator:

link

Zakładając, że obiektywy ostrzą najlepiej przy f:5.6 to na matrycy APS-C limit już mamy przy 22 Megapikselach.

Zresztą wystarczy porównać sobie sample z Canona 40D i 60D choćby na stronie www.dpreview.com. Te z 40D są ostre co do piksela, a z 60D są wszystkie lekko rozmyte gdyż przy f:8 już żaden obiektyw nie jest wstanie dać ostrego obrazu na matrycy 18 megapikselowej.

Porównujesz piksel w piksel, więc wady lepiej uwidocznią się na gęstszej matrycy. Zauważ jednak, że jeden milimetr gęstszej matrycy to więcej pikseli i linii zarejestrujesz tam więcej. A jeśli to co widzisz Cię nie przekonuje, to popatrz na pomiary bardziej napakowanych niż D7100 matryc Pentaxa Q czy Nikona 1.

To że limit dyfrakcyjny bardziej ogranicza napakowaną matrycę oznacza, że ,,górka'' rozdzielczości zaczyna się wcześniej. Jest ona jednak wyższa. Przy tej samej przysłonie rozdzielczość układu zawsze rośnie wraz z rozdzielczością matrycy, choć jest od góry ograniczona przez rozdzielczość szkła (czyli rośnie coraz wolniej).

Arek, to może inwestor albo niezależne dofinansowanie typu NCBR? Ludzie by się znaleźli, a dzięki takim pomiarom wyprzedzilibyście o dłuuugi krok wszystkie światowe serwisy testujące obiektywy.

Myśleliśmy o jakiś unijnych pieniądzach. Pomysł jeszcze nie umarł, bo wiem jakie to ma zalety.

Choć wiem, że i tak jednocześnie musiałbym testować po staremu. Larum by się straszne podniosło, że obiektywów nawet do aparatu podczas testu nie podpinam :)

Głupie pomysły laboranta. Potrzebny detektor ze szczeliną 1 mikrometr. Dla obiektywów do aparatów małoobrazkowych, bo w nich o ile pamiętam mamy krążek rozmycia kilka mikrometrów. Detektor umieszczamy na czymś drgającym. Amplituda ułamki mm. Dla równości rachunku przy ogniskowej 50 mm w odległości 5 metrów umieszczamy szczeliny i regulowanej odległości. Wystarczy zejść do kilku dziesiątych milimetra, bo "przekładnię" mamy x100. Oczywiście potrzeba tu jeszcze kilku "drobiazgów" jak precyzyjne mocowania...

A czy nie prościej ( niż liczyć teoretyczny splot lub budować maszynę ) było by zrobić tylko jedno

Dodać do testów obiektywów pomiar rozdzielczości obiektywów na najmniejszym wspólnym mianowniku tj na matrycy m43 z przejściówką ( tak wiem że to nie spełnia wszystkich wysokich kryteriów Optycznych)

Ale może na początek potraktować to jako mały eksperyment - dodatek do testów ( nikt z dużych graczy tego nie robi więc była by to też ciekawa metoda zwiększenia klikalności ;)

Nawet na zasadzie nie podoba nam się to ale spełniamy wymagania klientów ( czytelników ) początek tylko w centrum na jakimś penie lub panasie z 16 Mpix lub może nawet mniej.( bo to chyba nawet za dużo było by do testowania ciemniejszych tele )

Dla mnie byłby to 3-4 rozdział obowiązkowy do czytania w testach :)

@baron13,

Niepotrzebna jest żadna prawda absolutna.

Konstrukcja matrycy, jakość obrazowania i wycena włożonej w to pracy to domena producenta. Dlaczego zakładać, że producent chce nas okantować?

Wystarczy taki standard, jaki prezentuje w tej chwili Optyczne, żeby orientacyjnie ocenić matrycę czy obiektyw/ lornetkę. Nie można przecież przewidzieć jaka kombinacja korpusu z obiektywem/ -wami zostanie przez użytkownika wybrana.

Natomiast dobrze by było sprawdzić czy obiektywy tak bardzo limitują rozdzielczość matryc, że kupowanie napakowanych modeli traci sens. Weźmy np. Nikona D800 -- skoro robi się wersję bez filtra A-A i z filtrem to widocznie z obiektywami nie jest tak źle, ale gdy firma jak Tokina nie potrafi opanować CA, to chyba solidnością obudowy tego nie nadrobi?

Dobrze by było także zbadać po kilka egzemplarzy jakiegoś uniwersalnego zooma od podstawowych producentów, żeby określić rozrzut wykonania elementów i montażu. Jeśli ten rozrzut wyniesie ponad 10% to nie ma co się bawić w aptekę, tylko dostosować się do niego.

focjusz - to jest jakiś pomysł.

baron13 - jak już robić to kombajn, który zmierzy MFTy, astygmatyzm, winietę, dystorsję, CA i krzywiznę pola. Widziałem takie. Ale cena zabija :)

Na pewno coś warto zrobić w kierunku ułatwienia porównań między systemami. Nowe testy są na coraz bardziej gęstych matrycach, bez filtra, pojawiają się nowe formaty i ciężko to jest ogarnąć. Nawet wyżej widać było jak trudno porównać Zuiko 9-18 z tą Tokiną. Ja oceniłbym Olka w kategorii rozdzielczości lepiej, bo:

1) jest równiejszy dla różnych ogniskowych

2) nie trzeba domykać by osiągnąć maksimum

3) maksimum w centrum jest kilka lpmm niższe, brzeg - średnio taki sam, jednak D7000 ma osłabiony filtr AA przy zbliżonej gęstości, więc na tej samej matrycy centrum wypadłoby podobnie, a brzeg Zuiko - lepiej (tak sądzę, ktoś się zgadza :))?

Natomiast konkretny efekt na zdjęciu zależy także od wielkości matrycy, tu Tokina na APS-C sporo zyskuje. Ale z drugiej strony nie ma już w sprzedaży 10 Mpix matryc 4/3 z silnym filtrem AA, a na współczesnych 16 Mpix ze słabym filtrem MTFy są dużo wyższe (już nawet na 12 Mpix są). No ale z drugiej strony jest też D7100 w ogóle bez filtra... ;)

Dlatego pomysł focjusza mi się podoba. Nie podoba mi się ilość roboty z nim związana, bo:

1. w każdym teście mam dodatkową zabawę ze sprawdzeniem rozdzielczości w centrum

2. zabawa nie jest prosta, bo będę musiał testować obiektywy AF w trybie MF, a duża część z nich ma pierścienie MF, które są atrapami i nie pozwalają na precyzyjne ustawienia

3. czeka mnie ogromny test przejściówek. Do każdego mocowania muszę kupić ze trzy sztuki i wybrać najlepsze

4. muszę wydać pieniądze na same przejściówki (kilkadziesiąt sztuk) i Olympusa OMD EM-5 albo E-P5.

@Arek: doświadczenia są takie, że jak się skończy coś budować, to wreszcie wiemy, jak należało to zrobić. Dlatego zapewne najtaniej będzie kupić :-) Zrobienie mechaniki, nawet uczciwej ławy, żeby to wszytko się nie kolebało, to już może być nie lada wyzwanie.

@Cedrys: mimo wszystko dobrze wiedzieć jak jest. Przykładem mogą być te lustrzane Samyangi. Opinia o nich jest taka, że się nie dadzą używać. Przyczyną jednak nie jest optyczna jakość, tylko trudność z obsługą. W sumie wychodzi na jedno. Ale pod warunkiem że ktoś pyta "czy kupić". Nie, bo "zdjęcia nie wyjdą". Ale "mogą wyjść". Powtórzę raz jeszcze, że pomiary publikowane przez Optyczne są dla mnie najważniejsze. Opinie, punkty, to inna sprawa. Natomiast, pomiarom zawsze wierzę. Osobiście nie widzę jakiejś palącej potrzeby tworzenia super-laboratorium. Moim zdaniem i tak ludzie tu publikujący wyróżniają się wiedzą i na skutek tego fachowością. Inne portale próbują zajmować się sprzętem, ale wychodzi im to tak, że...

@baron:

Nie jestem pewien, czy to jest suma geometryczna.

Taka analogia z grafiki komputerowej. Jeżeli w jakimś demku, lub grze komputerowej mam 30fps. Jeżeli zmienię kartę graficzną na 2x szybszą oraz CPU na 2x szybsze to wtedy będę miał 60fps.

A co jak zmienię tylko kartę graficzną bez CPU?

Gdyby to była suma geometryczna to by wyszło, że będę miał 42fps (1.41x szybciej), a jednak w praktyce tak nie jest. W wielu grach wymiana karty graficznej na 2x szybszą spowoduje przyrost fps o 80-90% (1.8-1.9x szybciej). Dzieje się tak dlatego, że wydajność wielu gier zależy bardziej od karty graficznej niż od procesora i nie działa tutaj suma geometryczna.

@TS:

Ale jeżeli krążek dyfrakcji będzie większy niż piksel to zwiększenie wielkości matrycy nie jest już ekonomiczne. Już tłumaczę co mam na myśli.

Ja to rozumiem tak:

Trochę mi się analogia nasuwa do zdjęcia odcisku palca :) Chcemy zeskanować czyiś odcisk palca. Zakładając, że grubość "rowka" na palcu jest stała, to dobierając wielkość piksela o grubości takiego rowka otrzymamy pewien dokładny obraz odcisku. Teraz gdyby dobrać 10x mniejszy piksel otrzymamy tak jak mówisz ładniejszy obraz. Jednak żadnych więcej danych nie zarejestrujemy. Obraz "rowków" na rastrze pikseli będzie milszy dla oka, ale nie zarejestrujemy więcej "rowków" bo więcej ich nie ma.

To podobnie jest z tym krążkiem dyfrakcji. Mając 10x mniejszy piksel od średnicy krążka dyfrakcji zarejestrujemy jakby ładniejszy obraz samego krążka. Jakby bardziej okrągły, a nie "pikselowaty".

Jednak nie zarejestrujemy więcej szczegółów.

Najcieńsza linia jaką jesteśmy wstanie zarejestrować będzie miała grubość krążka dyfrakcji. Oczywiście będzie trochę mniej pikselowata, bo linia o grubości 10 małych pikseli wyglądać będzie ładniej niż linia gruba na 1 gruby piksel, bo w tym drugim przypadku będzie bardziej schodkowa.

Ale linii cieńszej niż krążek dyfrakcji nie zarejestrujemy i tak.

I w ten sposób jeżeli nie chcemy mieć prze ogromnych plików to ja bym chciał mieć taką rozdzielczość w której 1 piksel ma średnice krążka dyfrakcji. Bo większa rozdzielczość tutaj nie zarejestruje więcej linii. A tylko zwiększy wymiary pliku.

Co prawda jeszcze jest problem taki, że linie które nie są równoległe do poziomu/pionu matrycy będą lepiej rejestrowane przez matryce która ma gęściej pikseli. I chyba to miałeś na myśli. Ale już chyba przy 2 krotnie mniejszym pikselu od krążka dyfrakcji i to nie będzie mieć znaczenia - tak mi się wydaje.

Tak przynajmniej wynika z mojej wiedzy o dyfrakcji. Jak ktoś się zna to może mnie poprawić, bo nie jestem fizykiem.

baron13 - masz rację z tą budową. Przy kosztach tego typu urządzeń i podzespołów uczenie się na nich budowy jest drogą zabawą. Zamówienie sprzętu też nie zawsze załatwia sprawę. Zamówiliśmy przecież uniwersalny spektrofotometr, który miał zmierzyć wszelkiego rodzaju obiektywy i lornetki. Pewna firma podjęła się zadania, próbowała przez ponad rok, a potem oddała zaliczkę...

@TS:

A jeszcze jedno. Taka trochę psychologiczna kwestia. Ja po prostu lubię mieć ostrość na 1 piksel :) Na moim Canonie 40D jak oglądam zdjęcia to mam 1 pikselowe szczegóły rejestrowane. A jak oglądam sample z 60D to tam już obraz nie jest ostry co do piksela, tylko trochę rozmyty. Ja rozumiem, że jakby wydrukować na 70x50cm to obraz z 60D będzie odrobinę ostrzejszy.

Ale jestem pedantem tutaj i ja lubię obraz który jest jednak co do piksela ostry :)

Po za tym nie lubię jak plik zajmuję za dużo. Jeżeli ostrość nie jest na 1 piksel to znaczy, że marnujemy nie potrzebnie miejsce na dysku - tak to odczuwam.

Po za tym pliki z 60D ważą 2 razy więcej miejsca na dysku niż z 40D. A po wydrukowaniu ich na 70x50cm będą tylko odrobinę ostrzejsze. Dla mnie to jest nie ekonomiczne :)

Ja bym wolał by matryce miały dalej 10, max 15 megapikseli, a zamiast większej rozdzielczości, która i tak już nie wiele daje, miały np mniejsze szumy.

@Arek

3. czeka mnie ogromny test przejściówek. Do każdego mocowania muszę kupić ze trzy sztuki i wybrać najlepsze

Ale przecież taki test też by się nam czytelnikom przydał :) Nawet bardzo !

Tylko tym, który używają systemu Mikro 4/3 :)

Całkiem spora grupa ( i poprawi się czytelnictwo w Azji ;)

Poza tym nie upieram się - można zrobić na przejściówkach do Nexa - tylko one coś jakby nie teges to testów ...

Tylko najbardziej upakowany Olek wchodzi w rachubę. 16 MPix na u43 to nadal bardziej upakowana matryca niż 24 Mpix na APS-C. Poza tym Sony robi machlojki z filtrem AA...

@mgkiler nie ogarniam Cię... przecież rozdzielczość nie kończy się na krawędzi linii papilarnych :D a z tym odczuciem marnowania miejsca to zalatuje jakąś nerwicą więc z tym uważaj ;)

@mgkiler: jak napisał Arek, dokładnie to jest splot. Nie znając postaci funkcji traktuję je jak dwa sygnały przypadkowe i robię sumę geometryczną. To będzie takie około.

@baron13,

To nie są jedynie dwie proste funkcje fizyczne, które ze sobą interferują. Tutaj jest dużo więcej zmiennych, np.: filtr A-A, siatka Bayera, programowa rekonstrukcja barw i rozdzielczości po przejściu przez oba te filtry, gdzie się stosuje stochastyczne funkcje przejścia . Stosując matrycę monochromatyczną lub typu Foveon można by trochę zmniejszyć liczbę zmiennych, ale i tak nie sądzę, żeby się dało uzyskać proste wzory matematyczne. Jak np. wytłumaczyć wysokie winietowanie w konstrukcjach takich jak Sigma 35/1.4, gdzie producent optyki zdaje się mieć pełną kontrolę nad wadami?

@mgkiler,

Bardzo dobry przykład na nieproporcjonalny wzrost wydajności komputera. Ja tu widzę wyraźne podobieństwo.

@baron:

Nie bierzesz pod uwage dyfrakcji.

Poczytaj tutaj:

link

Tu masz napisane gdzie jest limit rozdzielczości i zależy on właśnie od dyfrakcji.

Gdyby nie istniało zjawisko dyfrakcji to wtedy byłby to splot.

"Diffraction is an optical effect which limits the total resolution of your photography — no matter how many megapixels your camera may have. It happens because light begins to disperse or "diffract" when passing through a small opening (such as your camera's aperture). "

link

Czyli nawet jakby zastosować nieskończenie małe piksele i idealny obiektyw to i tak na podstawie zjawiska dyfrakcji można policzyć maksymalną możliwą rozdzielczość do osiągnięcia. Więcej linii nie zarejestrujemy bo krążka dyfrakcji zmniejszyć się nie da.

@mgkiler,

Upraszczasz do bólu, popieram :). Co jednak, gdy plamka z obiektywu nie znajdzie się dokładnie na punktem matrycy? Albo, jak sam napisałeś, linia będzie ukośna? Zauważ, że pola do testowania rozdzielczości mają właśnie ukośne krawędzie, przecież to nie przypadek. Dochodzi to co pisał cedrys, interpolacja, między fotodiodami też są odstępy, itd.

Mniej upraszczając możesz opisać rozmycie punktu przez obiektyw jakąś ,,górką'' jasności, analogiczną ,,górkę'' produkuje matryca, w rezultacie masz splot tych dwóch funkcji. Jeśli rozmiar piksela matrycy maleje do zera, to rozdzielczość wzrasta, ale wzrost jest coraz wolniejszy (bo ograniczony przez szkło i dyfrakcję). W końcu przy dużych przysłonach przestaje być mierzalny - dlatego też Optyczni kupili Zeissy do testów matryc i pokazują wyniki już od f/4, choć kiedyś wystarczało f/5.6. Niemniej pomiary nadal wskazują, że warto pakować piksele na matryce APS-C, a że 1:1 nie wygląda to najlepiej... no to skalujemy albo wydruk ;)

@Arek,

Zakup E-M5 czy czegoś nowszego i tak przydałby się w testach szkieł m4/3 (autofokus i szumy E-PL1 są na słabym poziomie).

Co do nakładu pracy - był taki okres, że kilka obiektywów przetestował ktoś inny z redakcji, może to rozwiązałoby sprawę?

Mi się pomysł focjusza podoba, bo centrum jest mniej podatne na wady przejściówek niż brzeg, a brzeg można by oszacować zakładając podobny spadek rozdzielczości jak na natywnym mocowaniu...

Przykra sprawa z tym spektrofotometrem. No ale nie doszła dodatkowa praca w testach ;)

@TS:

Tak dla przypadku gdy linie znajdą się dokładnie "na krawędzi" 1:1 nie starczy. Ale gdy już piksel byłby 2 razy mniejszy od plamki dyfrakcji to wtedy wystarczy :)

A tymi ukośnymi liniami to też nie jestem przekonany, że to będzie rosło coraz wolniej, ale ciągle rosło. Z tym przykładem z odciskami palców właśnie chodziło mi o to, że mamy tam linie ukośne (a właściwie krzywe). Aby zarejestrować taką ukośną linie nie muszę mieć dwudziestu pikseli od jej krawędzi do krawędzi. Wydaje mi się, że tu też piksel 2 razy mniejszy niż grubość linii już by wystarczył by zarejestrować wszystkie ukośne linie.

Nie wiem skąd się wzięło to ,,dwa''. Trochę gdybanie. Model ze splotem prognozuje (coraz wolniejszy) wzrost rozdzielczości układu wraz ze wzrostem rozdzielczości matrycy, a realne pomiary to potwierdzają. Mi to wystarcza, nie chcę sięgać dalej, bo to całkiem skomplikowana dziedzina i nie moja zupełnie. Pokaż pomiary, które przeczą modelowi :)

Słabiutko Tokina, f4 powinna być żyleta a nie f8, gdzie na APS-C 18Mpix dyfrakcja powyżej f 6.2 niszczy rozdzielczość.

czekam na Samyanga 10mm 2.8 ;)

Nie rozumiem na czym polega problem. To nie wystarczy zmierzyć jednego obiektywu na starej i nowej matrycy i zrobić transformację wykresów? Przejsciówki to będzie droga przez mękę. Powstaną dzięki temu tylko memy, że Arek testuje Obiektywy FF na m43 bo tak jest podobno najlepiej... Naród nie pojmie sensu takiego działania.

Co do spektrofotometru, to mieliśmy we Wrocławiu taki:

link

W nim bez najmniejszych przeróbek można zainstalować obiektywy standardowe, ja mierzyłem tylko widma filtrów, bo było mi to potrzebne. Żeby zmieścić dłuższe trzeba by odsunąć dwa moduły od siebie co też nie wydaje się jakimś trudnym zadaniem. Kosztował nas z (niepotrzebnym tobie) oprogramowaniem ok. 100.000zł. Myślę, że za 50 byś go dostał bez tego oprogramowania.

Kupiłem to szkiełko z myślą o wakacjach 2013, wypoczynek, zwiedzanie. Po przypięciu do body wcale go nie zdejmuję. Na taki wyjazd mega uniwersalne szkiełko, ostrość powala, zakres super, a CA może wyszło mi na 1 fotce ze 100. Dokładnie jak napisał kolega mgkiler, CA wyszło przy dość specyficznych warunkach. Tak więc pisanie o monstrualnym CA można sobie w buty wsadzić.

Problem miałem natomiast z filtrami połówkowymi, cokin P winietował na 12mm. Musiałem zainwestować w holder z-pro i filtry Hitech-a. Brakuje mi w torbie LCW do tego szkiełka. Wiem, że można kupić, ale nie kosztuje mało, a boję się o winietkę.